LG AI연구원은 10일, 11일(현지시간) 양일간 프랑스 파리에서 열린 ‘AI 행동 정상회의(이하 AI 정상회의)’에 참석해 데이터의 신뢰성을 높이는 AI 기술을 제시했다고 12일 밝혔다.

LG AI연구원은 정상회의에서 참여해 각국의 고위 관계자들에게 데이터의 신뢰성을 높이는 AI 기술과 모두가 혜택을 누릴 수 있는 실천 방안 모색 등 지속 가능한 AI 개발을 위한 기업의 역할과 노력에 대해 알렸다. 이러한 내용을 담아 ‘AI 윤리 책무성 보고서’를 발간했다.

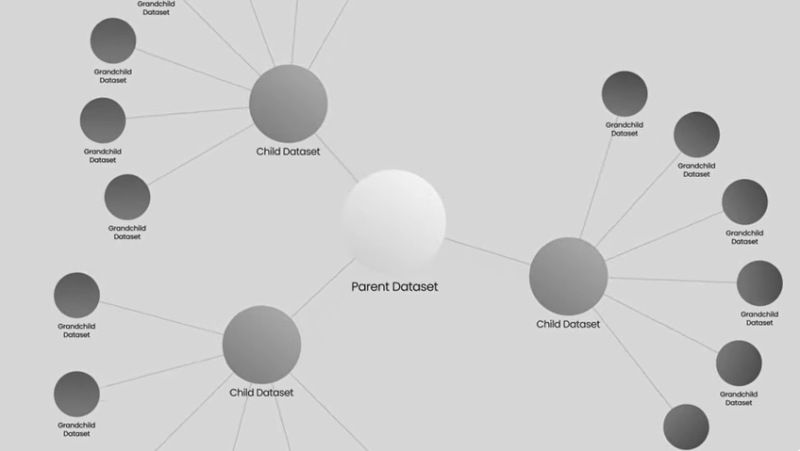

LG AI연구원은 모든 연구 과제를 대상으로 AI 윤리 영향 평가를 의무화했으며, 총 70개 과제에서 229건의 잠재적 위험을 식별해 개선 작업을 진행했다. 특히 AI 모델이 학습하는 데이터의 위험을 자동으로 분석하고 위험 등급을 평가하는 ‘데이터 컴플라이언스 에이전트(Data Compliance Agent)’를 개발해 운영 중이다. 수백 건의 실제 AI 학습 데이터셋의 라이선스, 저작권, 개인정보 보호 등 법적 안정성을 검토한 결과 법률 전문가와 비교해 정확도는 26%, 속도는 45배 높이고 비용은 0.1% 수준으로 낮췄다.

데이터 컴플라이언스 에이전트의 연구 성과를 공개하고 글로벌 표준 기술로 자리 잡을 수 있도록 글로벌 법률 전문가들과 협력을 강화할 계획이다.

LG AI연구원은 AI 행동 정상회의의 일환으로 유네스코와 함께 AI 거버넌스를 위한 국제 협력 방안을 논의하고 우수 사례를 공유하는 행사를 진행했다. ‘세상을 위한 AI(Preparing AI for the World)’란 주제로 진행된 행사에는 정상회의에 참석한 가브리엘라 라모스 유네스코 인문사회과학 사무총장보를 비롯해 각국의 장관, 기업 대표, 정책 입안자 등 300여 명이 참석했다.

배경훈 LG AI연구원장은 보고서 서문을 통해 “AI 기술이 사회에 미치는 영향력이 커질수록 책무성은 더욱 중요해지는 중”이라며 “LG AI연구원은 모든 연구개발 과제에 AI 윤리 영향 평가를 의무화해 잠재적 위험을 조기에 발견하고 개선했다”고 말했다.

이어 “엄격한 데이터 컴플라이언스 체계를 구축해 신뢰할 수 있는 개발의 토대를 마련했다”며 “신뢰할 수 있는 AI 기술력 확보를 넘어, 혜택이 사회 구성원 모두에게 돌아갈 수 있는 포용적 AI 생태계를 만드는 데 기여할 것”이라고 강조했다.

한편 LG AI연구원이 지난해 12월 오픈소스로 공개한 ‘엑사원(EXAONE) 3.5’ 32B 모델이 국가와 기업별 AI 경쟁력 척도에 활용하는 에포크(Epoch) AI의 주목할 만한 AI 모델(Notable AI Model) 리스트에 등재돼 기술 경쟁력을 인정받았다. 한국 모델이 등재된 것은 2년 만이다.